Andrey Doronichev geçen yıl sosyal ortamlarda Ukrayna cumhurbaşkanının Rusya’ya teslim olduğunu gösteren bir görüntü üzerinde paniğe kapılmıştı.

Görüntünün sentetik olarak oluşturulmuş bir derin sahte olduğu yuvaları çürütüldü, ancak Bay Doronichev için bu endişeli verici bir alarmdı. Bu yıl, güvencelere neden olabileceği tahribata rağmen yapay zeka bilimi öğrenme ve piyasaya sürmek için rekabet etmeye başladıkça, korkuları güvenliğini daha da yaklaştırıyor.

Üretken yapay zeka artık herkesin kullanımı açık ve insanlar tarafından kullanıyor ve yakalanmış gibi görünen metin, ses, görüntü ve videolarla insanları kandırma konusunda giderek daha yetenekli hale geliyor. Toplumsal saflık riski, dezenformasyon, iş çıkışı, kolları, mahremiyet ve geniş distopya ile ilgili endişeleri harekete geçirdi.

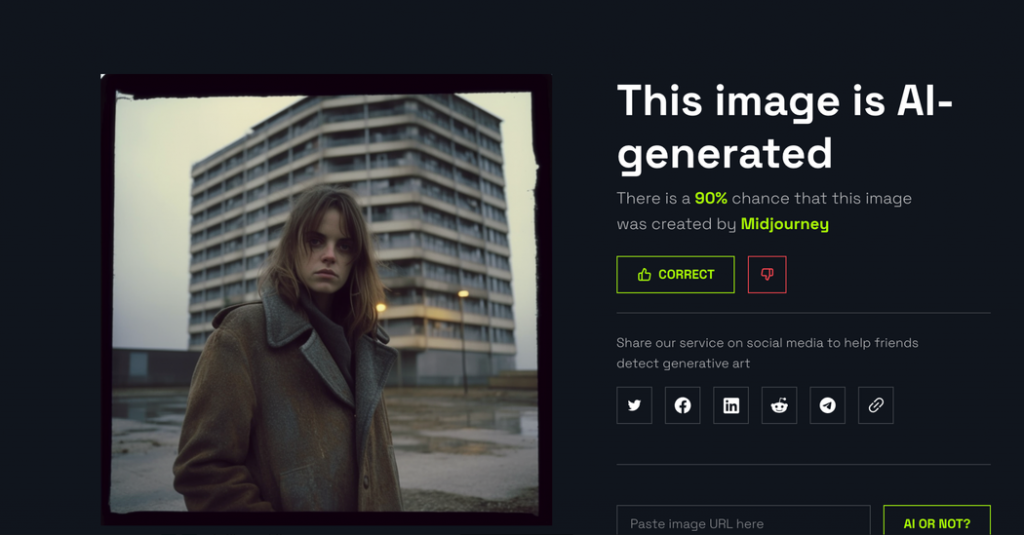

Bay Doronichev gibi girişimciler için aynı zamanda bir iş fırsatı haline geldi. Artık bir düzineden fazla şirket, Sensity AI (deepfake kısıtlamaları), Fictitious.AI (intihal sonuçları) ve Originality.AI (aynı zamanda intihal) gibi isimlerle bir şeyler yapay zeka kullanılarak yapılıp yapılmadığını belirlemek için araçlar sunuyor.

Bir Rus olan Bay Doronichev, sentetik veya sahte malzemeler tanımıya yardımcı olmak için San Francisco, Optic’te bir şirket kurdu – kendi deyimiyle “dijital içerik için bir istihdam röntgen makinesi” olmak.

Mart gördükten sonra, kullanıcıların gerçek fotoğraflar veya yapay zeka tarafından yapılıp yapılmadığını görmek için görüntüleme kontrol muhafazaları bir web görünümü. Görüntü ve sesi doğrulamak için başka hizmetler üzerinde çalışıyor.

Reface adlı bir yüz değiştirme yatırımcısı olan Bay Doronichev, “İçerik özgünlüğü, bir bütün olarak toplum için büyük bir sorun haline gelecek” dedi. “ Ucuz sahtecilik çağına giriyoruz.” Sahte içerik üretmenin maliyetinin çok yüksek olmaması için büyük ölçekte yapılabileceğini söyledi.

Pazar araştırma şirketi Grand View Research’e göre, genel üretken yapay zeka pazarının 2030 yüklerine kadar yıllık ortalama yüzde 35,6 büyüyerek 109 milyar doları aşması bekleniyor. Teknolojiyi tespit etmeye odaklanan işletmeler, endüstrinin büyüyen bir bölümü.

Bir Princeton Üniversitesi öğrencisi tarafından oluşturulduktan aylar sonra GPTZero, bir düşünce fazla kişinin programı bilgisayar tarafından üretilen metinleri ortaya çıkarmak için kullandığını iddia ediyor. Reality Defender, bu kış başlangıcında hızlandırıcı Y Combinator tarafından finanse edilmek üzere 17.000 başvuru arasından seçilen 414 şirketten oluşuyordu.

CopyLeaks, öğrencilerin çalışmalarında yapay zekayı tespit etmek için okullara ve üniversitelere yönelik intihal önleme operasyonlarını kendileri için geçen yıl 7,75 milyon dolar topladı. Kurucuları İngiliz Kraliyet Donanması ve Kuzey Atlantik Antlaşması Örgütü için siber güvenlik ve bilgi savaşında uzmanlaşan Sentinel, demokrasileri derin sahtekarlıklara ve diğer kötü niyetli yazılımlara karşı görevlilere yardımcı olmak için kişiselleştirilmiş Skype’ın kuruluş mühendislerinden biri tarafından işletimi 1,5 milyon kökenli bir başlangıç turunu 2020’de kapandı. sentetik ortam.

Büyük teknoloji şirketi de işin içinde: Intel’in FakeCatcher’ı, yazı insan yüzlerindeki ince kan görünümleri için pikselleri analiz ederek derin sahte videoları yüzde 96 doğrulukla tanımlayabildiğini iddia ediyor.

Federal hükümet bünyesinde, Savunma İleri Araştırma Projeleri Ajansı, derin sahtekarlıkları otomatik olarak tespit etmek ve kötü niyetli olup olmadığını belirlemek için görüşlerini geliştiren bir program olan Semantic Forensics’i kullanmak için bu yıl yaklaşık 30 milyon dolar harcamayı planlıyor.

Geçen yılın sonunda ChatGPT aracını piyasaya sürdüğünde AI patlamasını hızlandıran OpenAI bile algılama hizmetleri üzerinde çalışıyor. San Francisco merkezli şirket, bir insan tarafından yaratılan metin ile yapay zeka tarafından yazılan metinler arasında ayrım yapmaya yardımcı olan ücretsiz bir araç olan Ocak’ın elinde piyasaya sürdü.

OpenAI, aracın geçmiş yinelemelerde bir gelişme olmasına rağmen hala “tamamen güvenilir olmadığını” vurguladı. Araç, yapay olarak oluşturulmuş metin yüzdesi 26’sını doğru bir şekilde tanımladı, ancak hedeflenen içerik yüzdesi 9’unu bilgisayar tarafından oluşturulmuş olarak yanlış bir şekilde işaretledi.

OpenAI aracı, algılama programlarındaki yaygın kusurlarla dolu: İngilizce olmayan kısa metinler ve yazılarla mücadele eder. Eğitim ortamlarında, TurnItIn gibi intihal tespit araçlarında, öğrenciler tarafından yazılan makaleleri, chatbot’lar tarafından oluşturulmuş olarak yanlış bir şekilde algılamakla suçlanmıştır.

Tespit araçları, tespit etmeye çalıştıkları üreticinin elinde bulundurması gereken gerisinde kalıyor. Bir savunma sistemi, Google Bard veya Midjourney gibi yeni bir sohbet robotunun veya görüntü oluşturucunun çalışması tanındığında, geliştiriciler zaten bu savunmadan kaçabilecek yeni bir yineleme ile geliyorlar. Durum, kişinin diğerini tekrar tekrar doğurduğu bir silahlanma yarışı veya virüs-antivirüs ilişkisi olarak tanımlandı.

Üniversitede bilgisayar bilimi profesörü olan Hany Farid, “Midjourney, Midjourney 5’i piyasaya sürdüğünde marş tabancam ateşliyor ve ben yetişmek için çalışmaya başlıyorum – ve ben bunu yaparken, onlar Midjourney 6 üzerinde çalışıyorlar” dedi. Dijital tıpta yanması ve aynı zamanda AI tespitine maruz kalan yer alan California, Berkeley. “Ben dedektörü üzerinde bulundurma, kişinin daha iyi bir fare kapanı, daha iyi bir sentezleyici yaptığı, düşmanca bir oyun elde etmesi gerekir.”

New York Üniversitesi’nde siyaset profesörü ve Sosyal Medya ve Politika Merkezi’nin eş direktörü Joshua Tucker, sürekli yakalamaya rağmen, birçok şirket yöneticilerinden ve eğitimcilerden yapay zeka tespitine yönelik talep talimatlarını verdiğini söyledi. 2024 seçimleri öncesinde benzer bir pazarın ortaya çıkıp çıkmayacağını sorguladı.

“Siyasi adayları yardımcı olmak için bu işletmelerin bir tür paralel kanadının yöneticiliğini yapacaktır, böylece bu tür şeyler tarafından bir nevi hedef alındıklarını anlayabilirler” dedi.

Uzmanlar, sentetik olarak oluşturulmuş modelleme hala oldukça hantal ve tanımlamasının kolay olduğunu, ancak ses klonlamanın ve görüntü işlemenin her içeriğini de oldukça gelişmiş olduğunu söyledi. Gerçeği sahteden sınırlama, sürekli görüntü arama ve IP adresi izleme gibi dijital adli tıp taktiklerini gerektirecektir.

Mevcut yerleştirme programları, “dönen görüntünün değiştirildiği, kırpıldığı, küçültüldüğü, kodlarının değiştirildiği ve açıklama eklendiği ve Tanrı bilir onları başka neler olduğu, vahşi doğaya girmekten çok farklı” örneklerle test ediliyor. dedi Ferid Bey.

“Bu içeriğin aklanması, bunu zor bir görev haline getiriyor” diye ekledi.

1.000 şirket ve kuruluştan oluşan bir konsorsiyum olan Content Authenticity Initiative, yüksek düzeyde en inceden beri görünür kılmaya çalışan bir gruptur. (Adobe listesinde, The New York Times gibi üyeler ve Stability AI gibi yapay zeka oyuncuları ile) Grup, bir güdüler veya güdüler daha sonraki yaşam esaslarındaki kökenini bir araya getirmek yerine, standartlar oluşturmaya çalışıyor. İlişkilendirildikten sonra dijital çalışma için izlenebilir kimlik bilgileri.

Adobe, geçen hafta üretici teknolojisi Firefly’ın Google Bard’a entegre alıcını ve burada bir mimariye sahip olduğu tarih ve onu oluşturmak için kullanılan dijital araçlar da dahil olmak üzere oluşturduğu içeriği “beslenme önleyici” ekleyeceğini söyledi.

Tüketici kullanıcılarını zorlamaya yardımcı olan bir şirket olan Persona’nın güven ve güvenlik mimarı Jeff Sakasegawa, yapay zekanın ortaya çıkmasının ortaya çıkmasının daha yeni olduğunu söyledi.

“Dalga ivme kazanıyor” dedi. “Kıyıya doğru gidiyor. Henüz düşmediğini düşünüyorum.”